Transformers pour séries temporelles

Découvrez comment les Transformers révolutionnent la prévision de séries temporelles : météo, finance, IoT, santé, et bien plus encore.

Le défi des séries temporelles

Qu'est-ce qu'une série temporelle ?

Une série temporelle est une séquence de valeurs mesurées à intervalles réguliers dans le temps : température horaire, prix d'actions minute par minute, consommation électrique quotidienne, battements cardiaques par seconde, etc.

Exemples concrets

- • Météo : température, pression, humidité toutes les heures

- • Finance : prix d'actions, volumes d'échanges par minute

- • Santé : rythme cardiaque, glycémie, activité cérébrale

- • IoT : capteurs industriels, smart home, véhicules connectés

Pourquoi les Transformers ?

Traditionnellement, on utilisait des ARIMA, LSTM, ou Prophet. Mais les Transformers surpassent ces méthodes grâce à l'attention globalequi capture les dépendances à longue distance (saisonnalité annuelle, cycles économiques) et les relations entre variables (température ↔ consommation électrique).

Avantages clés

- • Capture les patterns saisonniers complexes

- • Gère les séries multivariées (plusieurs variables)

- • Robuste aux valeurs manquantes

- • Parallélisation de l'entraînement

- Série temporelle brute : 168 mesures horaires sur 7 jours

- Découpage en fenêtres : 7 fenêtres de 24 heures chacune

- Embedding de fenêtre : chaque fenêtre est convertie en un vecteur (moyenne, min, max, tendance)

- Positional encoding temporel : ajout d'informations sur l'heure, le jour, le mois

- Attention temporelle : chaque fenêtre peut "voir" les fenêtres passées et futures

- Prédiction : le Transformer prédit les valeurs futures (ex: température demain)

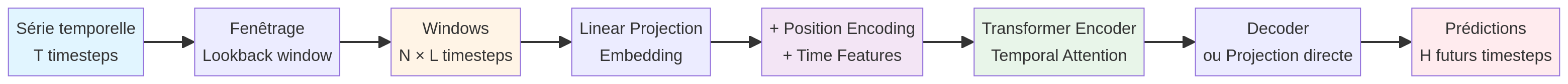

Architecture des Transformers pour séries temporelles

Pipeline complet pour séries temporelles : de la série brute aux prévisions futures

On découpe la série temporelle en fenêtres glissantes (lookback window). Par exemple, pour prédire la température de demain, on utilise les 168 dernières heures (7 jours). Chaque fenêtre est projetée dans un espace latent via un embedding.

Série [T timesteps, D features] → Windows [N, L, D] → Embedding [N, L, d_model]

N = nombre de fenêtres, L = longueur lookback, D = nombre de variables

On ajoute un encodage positionnel pour que le modèle sache l'ordre temporel. Souvent, on ajoute aussi des features temporelles : heure du jour, jour de la semaine, mois, jours fériés, etc.

Astuce : Les features temporelles (time features) aident le modèle à comprendre les patterns saisonniers (pic de consommation électrique à 19h, ventes élevées en décembre).

La séquence passe dans un Transformer Encoder avec attention multi-têtes. Chaque timestep peut "regarder" tous les autres timesteps pour comprendre les dépendances temporelles (tendances, cycles, saisonnalité).

Innovation : Certains modèles (Informer, Autoformer) utilisent des mécanismes d'attention spécialisés (sparse attention, autocorrelation) pour réduire la complexité sur de très longues séries.

Pour prédire les H prochains timesteps (horizon de prévision), on utilise soit un décodeur autorégressif (prédit step par step), soit une projection directe (prédit tous les H steps d'un coup).

Encoder output [L, d_model] → Decoder → Predictions [H, D]

H = horizon de prévision (ex: 24h), D = nombre de variables à prédire

Applications des Transformers pour séries temporelles

Les Transformers prédisent la météo à court/moyen terme en analysant les séries historiques de température, pression, humidité, vent. Ils capturent les patterns saisonniers et les interactions entre variables.

Performance

Les modèles Transformer surpassent les modèles numériques traditionnels sur des horizons de 1-7 jours.

Modèles

Pangu-Weather (Huawei), FourCastNet, GraphCast (DeepMind)

Les Transformers analysent les séries de prix, volumes, indicateurs techniques pour prédire les mouvements futurs. Ils capturent les dépendances complexes entre actifs et les événements macroéconomiques.

Applications

Trading algorithmique, gestion de portefeuille, détection d'anomalies, prévision de volatilité

Avantage

Capture les corrélations entre actifs et les patterns non-linéaires

Les Transformers prévoient la demande électrique (pics de consommation) et la production renouvelable (solaire, éolien) pour optimiser les réseaux électriques et réduire les coûts.

Impact

Réduction de 10-15% des coûts opérationnels grâce à une meilleure prévision

Cas d'usage

Load forecasting, production renouvelable, maintenance prédictive

Les Transformers analysent les séries temporelles médicales (ECG, EEG, glycémie, pression artérielle) pour détecter les anomalies, prédire les crises (épilepsie, arrêt cardiaque), et personnaliser les traitements.

Applications

Détection d'arythmies, prédiction de crises d'épilepsie, monitoring ICU

Précision

Détection d'arythmies avec 98%+ de précision (surpasse les méthodes classiques)

Les capteurs IoT génèrent des millions de séries temporelles (température machines, vibrations, pression). Les Transformers prédisent les pannes avant qu'elles ne surviennent, optimisant la maintenance.

Bénéfices

Réduction de 20-40% des temps d'arrêt non planifiés, économies de millions d'euros

Secteurs

Aéronautique, automobile, pétrole & gaz, manufacturing

Les Transformers prévoient les ventes futures en analysant les historiques, la saisonnalité (Noël, Black Friday), les promotions, et les tendances. Cela optimise les stocks et réduit le gaspillage.

Impact business

Réduction de 15-25% des ruptures de stock, amélioration de la marge

Utilisateurs

Amazon, Walmart, Alibaba utilisent des Transformers pour leurs prévisions

Modèles Transformers pour séries temporelles

Utilise ProbSparse attention pour réduire la complexité de O(L²) à O(L log L). Excellent pour les très longues séries (milliers de timesteps).

Long-term forecastingRemplace l'attention par l'autocorrélation pour mieux capturer les dépendances temporelles périodiques (saisonnalité).

Seasonal patternsDécoupe la série en patches (comme ViT pour les images). État de l'art sur de nombreux benchmarks. Simple et efficace.

State-of-the-artCombine Transformer et LSTM. Gère les variables statiques et dynamiques. Fournit des intervalles de confiance pour les prédictions.

InterpretablePremier modèle de fondation pour séries temporelles. Pré-entraîné sur 100 milliards de timesteps. Zero-shot forecasting sur n'importe quelle série.

Foundation modelModèle de fondation open-source basé sur l'architecture LLaMA. Entraîné sur des millions de séries temporelles diverses.

Open-sourceAvantages et limites

Dépendances à longue distance

L'attention globale capture les patterns saisonniers complexes (cycles annuels, tendances multi-années) que les LSTM peinent à modéliser.

Séries multivariées

Gère naturellement plusieurs variables corrélées (température ↔ consommation électrique, prix ↔ volume en finance).

Parallélisation

Contrairement aux RNN, les Transformers traitent tous les timesteps en parallèle, accélérant l'entraînement sur GPU.

Transfert learning

Les modèles de fondation (TimeGPT, Lag-Llama) peuvent être fine-tunés sur de petits datasets avec d'excellents résultats.

Coût computationnel

L'attention quadratique rend l'entraînement coûteux sur de très longues séries (10 000+ timesteps). Solutions : sparse attention, patches.

Besoin de données

Les Transformers nécessitent plus de données que les méthodes statistiques (ARIMA) ou les LSTM pour bien performer.

Interprétabilité

Moins interprétables que les modèles statistiques classiques. Difficile d'expliquer les prédictions aux métiers (finance, santé).

Overfitting sur petits datasets

Sur de très petits datasets (<1000 timesteps), les méthodes simples (ARIMA, Prophet) peuvent surpasser les Transformers.

Les Transformers pour séries temporelles révolutionnent la prévision en capturant les dépendances complexes à longue distance et les relations entre variables. Ils surpassent les méthodes classiques (ARIMA, LSTM) sur de nombreux benchmarks, notamment pour les prévisions à long terme et les séries multivariées.

L'émergence de modèles de fondation comme TimeGPT et Lag-Llama démocratise l'accès à des prévisions de haute qualité, même sans expertise en ML. Ces modèles pré-entraînés sur des milliards de timesteps peuvent être utilisés directement (zero-shot) ou fine-tunés sur des données spécifiques.

Votre retour est précieux pour améliorer cette page. Partagez votre expérience ci-dessous.

Comment les Transformers traitent-ils les séries temporelles ?

Comment évaluez-vous cette page ?

Pages connexes

Continuez votre apprentissage avec ces sujets liés