Construction d'un LLM de A à Z

Découvrez le processus complet de création d'un Large Language Model, depuis la collecte des données brutes jusqu'au chatbot conversationnel utilisable par le grand public.

Un voyage en 7 étapes

Créer un LLM comme GPT-4, Claude ou Gemini est un processus complexe qui nécessite des mois de travail, des milliards de données, des milliers de GPU, et des millions de dollars d'investissement.

Mais ne vous inquiétez pas ! Nous allons décomposer ce processus en 7 phases clairespour que vous compreniez exactement comment un modèle passe de "rien" à un assistant conversationnel capable de discuter naturellement.

Bon à savoir : Les étapes que nous décrivons ici correspondent au processus utilisé par OpenAI pour GPT-4, Anthropic pour Claude, et Google pour Gemini.

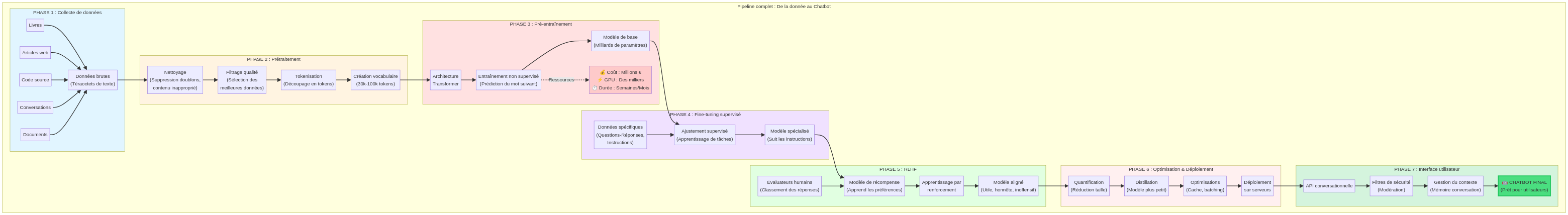

Vue d'ensemble du pipeline complet : de la donnée brute au chatbot

Concepts clés à comprendre

Avant de plonger dans les 7 phases, clarifions deux distinctions essentielles qui reviennent constamment dans la construction des LLM.

CPT (Continuous Pre-Training)

Objectif : Enrichir les connaissances du modèle

Données : Texte brut (articles, livres, code, Wikipedia)

Résultat : Le modèle "sait" plus de choses (nouveau domaine, nouvelle langue, données récentes)

SFT (Supervised Fine-Tuning)

Objectif : Modifier le comportement du modèle

Données : Paires instruction-réponse (format conversationnel)

Résultat : Le modèle "se comporte" différemment (suit les instructions, répond poliment, refuse les demandes dangereuses)

Analogie : CPT = lire des livres pour apprendre (savoir). SFT = suivre un cours pour appliquer (comportement).

Un modèle "Instruct" (ou "Chat") est un modèle qui a subi SFT + RLHF pour devenir conversationnel et suivre les instructions.

Modèle brut (base)

Exemple : GPT-4o, Llama 3.3 70B

❌ Complète le texte mais ne suit pas les instructions

❌ Peut générer du contenu toxique ou dangereux

Modèle Instruct (fine-tuné)

Exemple : GPT-4o Turbo, Llama 3.3 70B Instruct

✅ Suit les instructions de l'utilisateur

✅ Répond de manière utile et sécurisée

✅ Refuse les demandes dangereuses ou illégales

En pratique : Quand vous utilisez ChatGPT, Claude ou Gemini, vous interagissez avec un modèle Instruct, pas avec le modèle brut.

Collecte et préparation des données

La fondation de tout LLM : des milliards de textes

Pour qu'un LLM comprenne le langage humain, il doit d'abord "lire" une quantité astronomique de texte. Voici les sources typiques :

Web crawling

Milliards de pages web (Wikipedia, blogs, forums, sites d'actualités, documentation technique)

Livres et publications

Millions de livres, articles scientifiques, brevets, documents académiques

Code source

Dépôts GitHub, Stack Overflow, documentation de programmation (pour les capacités de code)

Conversations

Reddit, Twitter, forums de discussion (pour comprendre le langage conversationnel)

Nettoyage crucial : Les données brutes contiennent du spam, du contenu toxique, des doublons, des erreurs. Une étape de filtrage et de nettoyage est essentielle pour la qualité du modèle.

Exemple GPT-3 : ~570 Go de texte compressé = ~300 milliards de tokens (environ 400 milliards de mots)

Tokenisation et vocabulaire

Transformer le texte en nombres que le modèle peut comprendre

Avant d'entraîner le modèle, il faut convertir chaque mot (ou morceau de mot) en un nombre unique appelé token. C'est le rôle du tokenizer.

Exemple concret :

"Les Transformers sont révolutionnaires"["Les", " Transform", "ers", " sont", " révolution", "naires"][2356, 8745, 1234, 5678, 9012, 3456]Algorithmes populaires

- •BPE (Byte Pair Encoding) : Utilisé par GPT

- •WordPiece : Utilisé par BERT

- •SentencePiece : Utilisé par T5, LLaMA

Taille du vocabulaire

- •GPT-2 : 50 257 tokens

- •GPT-3 : 50 257 tokens

- •GPT-4 : ~100 000 tokens (estimé)

Pré-entraînement (Pre-training)

Apprendre les patterns du langage sur des milliards de textes

C'est l'étape la plus longue et la plus coûteuse. Le modèle apprend à prédire le mot suivantdans une phrase en lisant des milliards d'exemples. Cette tâche simple en apparence lui permet d'acquérir une compréhension profonde du langage.

Exemple d'apprentissage :

Texte d'entraînement :

"Le chat dort sur le canapé"

Le modèle voit :

"Le chat dort sur le [?]"

Il doit prédire :

Probabilités : canapé (85%), tapis (10%), lit (3%), table (2%)

Ressources nécessaires

Ce que le modèle apprend

- Grammaire et syntaxe de dizaines de langues

- Connaissances factuelles (histoire, science, culture)

- Raisonnement logique et mathématique

- Programmation et syntaxe de code

- Contexte culturel et références

Fine-tuning supervisé (SFT)

Apprendre à suivre des instructions et répondre aux questions

Après le pré-entraînement, le modèle sait prédire des mots, mais il ne sait pas encore répondre à des questions ou suivre des instructions. Le fine-tuning supervisé lui apprend ce comportement avec des exemples de haute qualité.

Exemple de données de fine-tuning :

👤 Utilisateur :

"Explique-moi ce qu'est la photosynthèse en termes simples."

🤖 Assistant (réponse idéale) :

"La photosynthèse est le processus par lequel les plantes utilisent la lumière du soleil pour transformer l'eau et le CO₂ en glucose (leur nourriture) et en oxygène. C'est comme si les plantes 'mangeaient' de la lumière !"

Volume de données

Beaucoup moins que le pré-entraînement : typiquement 10 000 à 100 000 exemplesde conversations de haute qualité.

Ces exemples sont souvent créés manuellement par des humains experts.

Durée d'entraînement

Quelques jours à quelques semaines (beaucoup plus rapide que le pré-entraînement).

Le modèle "affine" ses capacités existantes plutôt que d'apprendre from scratch.

Fine-tuning moderne : LoRA, QLoRA et au-delà

Découvrez comment entraîner des LLM sur votre PC avec seulement 8-16 GB de VRAM grâce aux techniques révolutionnaires développées en 2023-2024.

Calculateur de VRAM Interactif

Full Fine-tuning : Entraîne tous les paramètres (4x la mémoire)

LoRA : Entraîne seulement des adapters (économise 70-80% de VRAM)

QLoRA : LoRA + quantization INT4 (économise 85-95% de VRAM)

Entraîner tous les paramètres d'un LLM (Full Fine-tuning) nécessite une mémoire énorme :

💰 Coût prohibitif : Une A100 80GB coûte ~$15,000. Pour entraîner GPT-3, il faudrait 10+ GPU A100, soit plus de $150,000 en matériel !

🎯 L'idée géniale de LoRA

Au lieu de modifier les 175 milliards de paramètres de GPT-3, LoRA ajoute de petits "adapters" (matrices de rang faible) qui ne représentent que 0.1-1% des paramètres.

Modèle original : W (matrice 1000×1000)

LoRA ajoute : ΔW = A × B

où A (1000×8) et B (8×1000)

→ Au lieu de 1M paramètres, seulement 16K paramètres à entraîner !

Avantages de LoRA

- ✓70-80% moins de VRAM : Llama 2 7B passe de 28GB à ~8GB

- ✓Entraînement 3-5x plus rapide car moins de paramètres

- ✓Adapters légers : seulement quelques MB vs plusieurs GB

- ✓Modulaire : charger différents adapters pour différentes tâches

Résultats typiques

Cas d'usage : LoRA est parfait pour adapter un modèle à un domaine spécifique (médical, juridique, code) ou à un style d'écriture particulier.

🚀 La révolution QLoRA (2023)

QLoRA va encore plus loin : il quantize le modèle de base en INT4 (4 bits) tout en gardant les adapters LoRA en précision normale. Résultat : entraîner Llama 2 70B sur une seule RTX 4090 24GB !

Innovations de QLoRA

- 1.NF4 (Normal Float 4-bit) : quantization optimale pour les poids

- 2.Double quantization : quantize même les constantes de quantization

- 3.Paged Optimizers : gestion intelligente de la mémoire

Performance

🎯 Impact : QLoRA démocratise le fine-tuning de LLM. Des chercheurs et startups peuvent maintenant entraîner des modèles 70B sur du matériel grand public (~$2,000 au lieu de $100,000+).

Comparaison des techniques de Quantization

La quantization permet de réduire drastiquement la taille des modèles (jusqu'à 8×) en diminuant la précision numérique. Voici un comparatif détaillé des 5 principales méthodes utilisées en 2024.

Sélectionnez une méthode pour voir les détails :

| Méthode | Bits | Vitesse | Mémoire | Qualité | GPU | CPU | Meilleur pour |

|---|---|---|---|---|---|---|---|

| GPTQ | 2-8 bits | ★★★★★ | ★★★★★ | ★★★★★ | Inférence GPU rapide | ||

| AWQ | 4 bits | ★★★★★ | ★★★★★ | ★★★★★ | Meilleure qualité 4-bit | ||

| GGUF | 2-8 bits | ★★★★★ | ★★★★★ | ★★★★★ | Exécution CPU | ||

| GGML | 4-8 bits | ★★★★★ | ★★★★★ | ★★★★★ | Projets legacy | ||

| bitsandbytes | 4-8 bits | ★★★★★ | ★★★★★ | ★★★★★ | Fine-tuning avec QLoRA |

Légende : Vitesse = rapidité d'inférence | Mémoire = économie VRAM | Qualité = préservation de la performance du modèle original

Vitesse

Économie mémoire

Qualité

Compatibilité

🎯 Meilleur pour :

- Inférence GPU rapide

- Production avec GPU NVIDIA

- Modèles 7B-70B

✅ Avantages

- Très rapide sur GPU NVIDIA

- Excellente compression (4-bit typique)

- Large support dans l'écosystème Hugging Face

- Optimisé pour les architectures modernes (Llama, Mistral)

❌ Inconvénients

- Ne fonctionne PAS sur CPU

- Nécessite GPU avec support CUDA

- Quantization initiale lente (plusieurs heures)

- Perte de qualité légèrement supérieure à AWQ

🖥️ Vous avez un GPU NVIDIA moderne

→ Utilisez GPTQ ou AWQ

GPTQ pour la vitesse maximale, AWQ pour la meilleure qualité. Les deux sont excellents pour l'inférence en production.

💻 Vous utilisez un Mac M1/M2/M3

→ Utilisez GGUF avec llama.cpp

GGUF est optimisé pour Metal et offre d'excellentes performances sur les puces Apple Silicon.

🔬 Vous voulez faire du fine-tuning

→ Utilisez bitsandbytes avec QLoRA

Intégration native avec Transformers et PEFT. Parfait pour entraîner des modèles 7B-70B sur une seule RTX 3090/4090.

🌐 Vous n'avez PAS de GPU

→ Utilisez GGUF sur CPU

GGUF est le seul format vraiment optimisé pour CPU. Fonctionne sur n'importe quel ordinateur avec llama.cpp.

Astuce : Pour la plupart des cas d'usage en production avec GPU NVIDIA,AWQ offre le meilleur compromis qualité/vitesse en 2024. Pour CPU ou Mac,GGUF est incontournable.

| Format | Taille | VRAM requise | Compression | Perplexité (↓ mieux) |

|---|---|---|---|---|

| FP16 (original) | 13.5 GB | ~14 GB | — | 5.68 |

| GPTQ 4-bit | 3.9 GB | ~5 GB | 3.5× | 5.83 |

| AWQ 4-bit | 3.9 GB | ~5 GB | 3.5× | 5.75 (meilleur) |

| GGUF Q4_K_M | 4.1 GB | ~6 GB | 3.3× | 5.81 |

| bitsandbytes NF4 | 3.5 GB | ~5 GB | 3.9× | 5.77 |

Perplexité : Mesure de la qualité du modèle (plus bas = meilleur). Testé sur WikiText-2. Une différence de 0.1 est généralement imperceptible pour l'utilisateur final.

Conclusion : Toutes les méthodes 4-bit offrent une compression ~3.5× avec une perte de qualité minime (<3%). AWQ et bitsandbytes NF4 préservent légèrement mieux la qualité que GPTQ.

📚 Qu'est-ce que c'est ?

Au lieu de partir de zéro, on prend un modèle pré-entraîné (comme Llama 2) et on continue son entraînement sur des données spécialisées (médicales, juridiques, code, etc.).

Exemple : Créer un LLM médical

- 1. Partir de Llama 2 7B (déjà entraîné sur le web)

- 2. Continuer l'entraînement sur 50GB d'articles médicaux

- 3. Résultat : modèle qui comprend mieux le jargon médical

Différence avec Fine-tuning

Continuous Pretraining

Objectif : Apprendre de nouvelles connaissances (vocabulaire, faits)

Fine-tuning

Objectif : Apprendre un nouveau comportement (suivre instructions)

Cas d'usage populaires

- Code : CodeLlama (Llama 2 + code Python/C++/Java)

- Médical : Med-PaLM (PaLM + littérature médicale)

- Juridique : LegalBERT (BERT + textes de loi)

- Multilingue : Ajouter une nouvelle langue

Astuce : Continuous Pretraining peut être combiné avec LoRA/QLoRA pour économiser de la VRAM !

🤖 L'IA qui s'améliore seule

Le Self-Tuning regroupe des techniques où le modèle génère ses propres données d'entraînement, s'auto-critique, et s'améliore de manière autonome. C'est une des pistes les plus prometteuses pour dépasser les limites actuelles.

Le modèle génère ses propres instructions et réponses, puis s'entraîne dessus.

Processus :

- 1. Modèle génère 1000 questions variées

- 2. Modèle génère les réponses

- 3. Filtre automatique de qualité

- 4. Fine-tuning sur ces données

Le modèle s'auto-critique selon des principes éthiques et améliore ses réponses.

Processus :

- 1. Modèle génère une réponse

- 2. Modèle critique sa réponse

- 3. Modèle génère version améliorée

- 4. Répète jusqu'à satisfaction

Le modèle joue contre lui-même pour s'améliorer (comme AlphaGo).

Applications :

- • Débats : deux instances argumentent

- • Jeux : échecs, poker, stratégie

- • Raisonnement : résolution de problèmes

Le modèle améliore itérativement ses propres réponses.

Exemple (code) :

- 1. Génère du code

- 2. Exécute et voit l'erreur

- 3. Corrige automatiquement

- 4. Répète jusqu'à succès

⚠️ Limites : Le Self-Tuning peut amplifier les biais existants et générer des "hallucinations" si mal contrôlé. La supervision humaine reste importante.

🚀 Futur : Le Self-Tuning pourrait permettre aux LLM de s'améliorer continuellement sans intervention humaine, ouvrant la voie à l'AGI (Intelligence Artificielle Générale).

| Technique | VRAM (7B) | Temps | Qualité | Cas d'usage |

|---|---|---|---|---|

| Full Fine-tuning | 28 GB | Lent | ★★★★★ | Budget illimité, max qualité |

| LoRA | 8-12 GB | Moyen | ★★★★☆ | Bon compromis, GPU moyen |

| QLoRA | 4-6 GB | Rapide | ★★★★☆ | GPU grand public, optimal |

| Continuous PT | Variable | Long | ★★★★★ | Nouveau domaine/langue |

| Self-Tuning | Variable | Variable | ★★★☆☆ | Recherche, auto-amélioration |

RLHF : Apprentissage par renforcement

Aligner le modèle avec les préférences humaines

Le RLHF est la technique qui a permis à ChatGPT de devenir viral. Elle consiste à faire évaluer les réponses du modèle par des humains, puis à utiliser ces évaluations pour améliorer le modèle via l'apprentissage par renforcement.

3 méthodes principales : PPO (classique, utilisé par OpenAI), DPO (moderne, utilisé par Llama/Mistral), KTO (récent, 2024).

Le Reward Model est un modèle entraîné à prédire quel texte un humain préférerait. Il sert de "juge automatique" pour évaluer les réponses du LLM.

Processus de création du RM :

Génération de paires

Pour chaque prompt, le LLM génère 2 réponses (A et B).

Classement humain

Des évaluateurs choisissent la meilleure réponse (ex: A > B).

Entraînement du RM

Le RM apprend à prédire ces préférences (score plus élevé pour A que B).

Exemple : Prompt = "Explique la gravité"

Réponse A (score RM = 8.2) : Explication claire et pédagogique

Réponse B (score RM = 3.1) : Réponse confuse et incorrecte

PPO est l'algorithme d'apprentissage par renforcement qui utilise le Reward Model pour améliorer le LLM. C'est la méthode originale du RLHF.

Comment fonctionne PPO :

Génération

Le LLM génère une réponse pour un prompt.

Évaluation

Le Reward Model attribue un score à la réponse.

Optimisation

Le LLM ajuste ses paramètres pour maximiser le score (tout en restant proche du modèle SFT initial).

Avantages

- • Stable et éprouvé (utilisé par OpenAI, Anthropic)

- • Qualité maximale des réponses

- • Contrôle fin de l'alignement

Inconvénients

- • Très complexe à implémenter

- • Nécessite 4 modèles en mémoire (~80 GB VRAM)

- • Lent et coûteux en calcul

Astuce : PPO nécessite 4 modèles : LLM policy, LLM reference, Reward Model, Value Model. C'est pourquoi il est si gourmand en VRAM.

DPO est une innovation récente (2023) qui simplifie radicalement le RLHF en éliminant le Reward Model et PPO. Au lieu d'entraîner un RM puis d'utiliser PPO, DPO optimise directement le LLM avec les préférences humaines.

Comment fonctionne DPO :

Données de préférence

Collecter des paires (prompt, réponse préférée, réponse rejetée).

Optimisation directe

Entraîner le LLM à augmenter la probabilité de la réponse préférée et diminuer celle de la réponse rejetée.

Une seule étape

Pas besoin de Reward Model ni de PPO. Tout se fait en un seul entraînement.

Avantages

- • Beaucoup plus simple à implémenter

- • Plus rapide (1 modèle au lieu de 4)

- • Moins gourmand en VRAM (~20 GB au lieu de 80 GB)

- • Résultats comparables à PPO

Limites

- • Moins de contrôle fin qu'avec PPO

- • Peut être moins stable sur certains domaines

- • Nécessite des données de préférence de qualité

Qui utilise DPO : Meta (Llama 3.3), Mistral AI, HuggingFace (TRL library). C'est devenu la méthode standard pour les modèles open-source.

KTO (2024) est une méthode encore plus récente que DPO, inspirée par la théorie des perspectives de Kahneman et Tversky (Prix Nobel 2002). Elle modélise le fait que les humains sont plus sensibles aux pertes qu'aux gains.

Principe de KTO :

Feedback binaire

Au lieu de comparer 2 réponses, on demande juste "Cette réponse est-elle bonne ?" (Oui/Non).

Asymétrie gain/perte

KTO pénalise plus fortement les mauvaises réponses qu'il ne récompense les bonnes (λ_loss > λ_gain).

Optimisation

Le modèle apprend à maximiser les réponses positives tout en évitant fortement les négatives.

Avantages

- • Feedback plus simple à collecter (Oui/Non)

- • Modélise mieux la psychologie humaine

- • Peut être plus efficace avec moins de données

Limites

- • Très récent (2024), moins éprouvé

- • Peu d'implémentations disponibles

- • Recherche encore en cours

Recherche active : KTO est une direction prometteuse pour rendre le RLHF encore plus accessible et efficace. À suivre en 2025 !

| Critère | PPO | DPO | KTO |

|---|---|---|---|

| Complexité | ❌ Très complexe | ✅ Simple | ✅ Simple |

| Modèles requis | 4 modèles | 1 modèle | 1 modèle |

| VRAM | ~80 GB | ~20 GB | ~20 GB |

| Vitesse | ❌ Lent | ✅ Rapide | ✅ Rapide |

| Qualité | ✅ Excellente | ✅ Très bonne | ❓ À confirmer |

| Données | Comparaisons (A > B) | Comparaisons (A > B) | Binaire (Oui/Non) |

| Maturité | ✅ Éprouvé (2020) | ✅ Mature (2023) | ⚠️ Récent (2024) |

| Qui l'utilise | OpenAI, Anthropic | Meta, Mistral, HF | Recherche |

| Recommandé pour | Qualité maximale | Projets open-source | Expérimentation |

Verdict : Quelle méthode choisir ?

- PPO : Si vous avez des ressources illimitées et voulez la meilleure qualité possible (OpenAI, Anthropic)

- DPO : Pour la plupart des projets (open-source, startups, recherche). Excellent compromis simplicité/qualité

- KTO : Si vous voulez expérimenter avec les dernières innovations (2024-2025)

Déploiement et optimisation

Rendre le modèle rapide et accessible à des millions d'utilisateurs

Un modèle entraîné n'est pas encore prêt pour des millions d'utilisateurs. Il faut l'optimiser pour qu'il soit rapide, économique, et capable de gérer des millions de requêtes simultanées.

Quantization

Réduire la précision des poids (32 bits → 8 bits) pour économiser mémoire et calcul

Distillation

Créer un modèle plus petit qui imite le grand modèle (ex: DistilBERT, GPT-3.5-turbo)

Caching

Mémoriser les réponses fréquentes pour éviter de recalculer

Batching

Traiter plusieurs requêtes en parallèle pour maximiser l'utilisation GPU

Serveurs GPU

Des milliers de GPU (A100, H100) répartis dans le monde entier

Load balancing

Distribuer les requêtes entre les serveurs pour éviter la surcharge

Monitoring

Surveillance en temps réel des performances et détection d'anomalies

Rate limiting

Limiter le nombre de requêtes par utilisateur pour gérer la charge

Coûts d'exploitation

Faire tourner un LLM comme GPT-4 coûte extrêmement cher :

Serveurs

~700 000 $ / jour

Électricité

~50 000 $ / jour

Total estimé

~250M $ / an

Interface conversationnelle

Du modèle brut au chatbot utilisable par tous

Le modèle est prêt, mais les utilisateurs ont besoin d'une interface simplepour l'utiliser. C'est là qu'intervient le développement de l'application conversationnelle.

Composants de l'interface

Chat UI

Interface de conversation avec historique, formatage Markdown, code highlighting

Gestion du contexte

Mémoriser la conversation pour maintenir la cohérence (fenêtre de contexte)

Streaming

Afficher la réponse mot par mot en temps réel (comme ChatGPT)

Modération

Filtrer les contenus inappropriés en entrée et en sortie

Fonctionnalités avancées

Plugins & Tools

Permettre au modèle d'utiliser des outils externes (calculatrice, recherche web, génération d'images)

Multimodalité

Accepter des images, audio, vidéo en entrée (GPT-4 Vision, Gemini)

Personnalisation

Instructions personnalisées, mémoire long terme, préférences utilisateur

API

Permettre aux développeurs d'intégrer le modèle dans leurs applications

Et voilà ! 🎉

Après ces 7 étapes, vous avez un LLM complet et fonctionnel comme ChatGPT, Claude ou Gemini, prêt à être utilisé par des millions de personnes dans le monde entier !

Récapitulatif du pipeline complet

Milliards de textes du web

Mots → Nombres

Apprendre le langage

Suivre instructions

Alignement humain

Optimisation prod

Chatbot final

Vous voulez approfondir ?

Explorez les autres sections pour comprendre en détail l'architecture des Transformers et le mécanisme d'attention qui rend tout cela possible.

Testez vos connaissances

Vérifiez votre compréhension des concepts clés avec ce quiz interactif

Quelle est la principale différence entre le pré-entraînement et le fine-tuning ?

Quiz Vrai ou Faux

Vérifiez votre compréhension du pipeline de construction d'un LLM

Le pré-entraînement (pre-training) d'un LLM nécessite des données annotées par des humains.

Quiz Glisser-Déposer

Ordonnez les étapes de construction d'un LLM dans le bon ordre

Ordonnez les étapes de construction d'un LLM de A à Z

💡 Indice : Commencez par les données, puis l'entraînement général, l'ajustement spécifique, et enfin le déploiement.

Glissez les éléments pour les ordonner correctement, ou utilisez les boutons ⬆️ ⬇️

Quiz de Correspondance

Associez chaque phase du pipeline à son objectif

Associez chaque phase du pipeline LLM à son objectif

Cliquez sur un concept puis sur sa définition pour les associer

CONCEPTS

DÉFINITIONS

Votre retour est précieux pour améliorer cette page. Partagez votre expérience ci-dessous.

Comment évaluez-vous cette page ?

Pages connexes

Continuez votre apprentissage avec ces sujets liés