Audio Transformers

Découvrez comment les Transformers révolutionnent le traitement audio : reconnaissance vocale, génération musicale, séparation de sources, et bien plus encore.

Du son aux tokens : le défi audio

Le signal audio brut

Un fichier audio est une séquence temporelle de valeurs d'amplitude (forme d'onde). Par exemple, un audio de 10 secondes à 16 kHz contient 160 000 échantillons ! Impossible de traiter chaque échantillon comme un token.

Exemple concret

Audio 10s @ 16kHz = 160 000 échantillons. Avec l'attention classique, cela nécessiterait 160 000² ≈ 25 milliards d'opérations !

La solution : spectrogrammes et fenêtres

On convertit l'audio en spectrogramme (représentation temps-fréquence) via une transformée de Fourier. Puis on découpe en fenêtres temporelles qui deviennent des tokens. Un audio de 10s devient ~300 tokens au lieu de 160 000 échantillons.

Réduction spectaculaire

160 000 échantillons → 300 tokens spectraux. L'attention ne calcule plus que 300² = 90 000 opérations. C'est 280 000 fois moins !

- Signal audio brut : onde temporelle (amplitude × temps)

- Transformation de Fourier (STFT) : décompose le signal en fréquences au fil du temps

- Spectrogramme Mel : 64 bandes de fréquence × 100 pas de temps = 6400 valeurs

- Découpage en tokens : regroupement temporel → 50 tokens

- Embedding : chaque token est converti en vecteur de dimension 768-1024

- Transformer : traite la séquence de 50 tokens avec attention

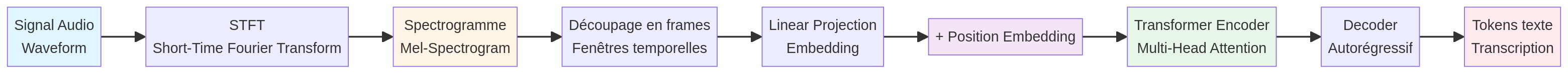

Pipeline de traitement audio avec Transformers

Pipeline complet de traitement audio : du signal brut à la transcription textuelle

On applique une transformée de Fourier à court terme (STFT) pour obtenir un spectrogramme. Chaque colonne représente les fréquences présentes à un instant donné. On obtient une matrice [temps, fréquences].

Audio [160000 samples] → STFT → Spectrogramme [300 frames, 80 mel bins]

Chaque frame spectral (vecteur de 80 mel bins) est projeté dans un espace de dimension D via une couche linéaire. On ajoute un encodage positionnel pour que le modèle sache l'ordre temporel des frames.

300 frames [80] → Linear(80, D) + Position Encoding → 300 tokens [D]

La séquence de tokens passe dans un Transformer Encoder. Chaque frame peut "écouter" tous les autres frames pour comprendre le contexte temporel global (phonèmes précédents/suivants, mélodie, rythme).

Avantage clé : Contrairement aux RNN, les Transformers capturent les dépendances à longue distance (plusieurs secondes) sans problème de gradient.

Pour la reconnaissance vocale, on utilise un décodeur autorégressif qui génère du texte token par token. Pour la classification (genre musical), on agrège avec un token [CLS]. Pour la génération, on prédit les frames suivants.

Reconnaissance vocale : Encoder output → Decoder → Texte transcrit

Applications des Audio Transformers

Whisper (OpenAI) est un modèle Transformer entraîné sur 680 000 heures d'audio multilingue. Il transcrit la parole avec une précision proche de l'humain, même avec du bruit de fond, des accents variés, et 99 langues.

Performance

Whisper Large-v3 : WER 4.7% sur LibriSpeech (meilleur que les humains sur certains benchmarks)

Modèles

Whisper, Wav2Vec2, HuBERT, Conformer

MusicGen (Meta) et AudioLM (Google) génèrent de la musique cohérente (mélodie, harmonie, rythme) à partir de descriptions textuelles ou en continuant un extrait audio. Ils comprennent les structures musicales complexes.

Capacités

Génération conditionnelle par texte, continuation, variations stylistiques

Modèles

MusicGen, AudioLM, Jukebox, MuseNet, Riffusion

Les Transformers génèrent une parole ultra-réaliste avec intonation, émotions et prosodie naturelles. VALL-E (Microsoft) peut cloner une voix avec seulement 3 secondes d'audio de référence.

Applications

Assistants vocaux, audiobooks, doublage, accessibilité

Modèles

VALL-E, Bark, Tortoise TTS, VITS

Les Transformers séparent un mix audio en pistes individuelles (voix, batterie, basse, guitare). Utile pour le remixage, le karaoké, l'analyse musicale, et la restauration audio.

Outils populaires

Spleeter (Deezer), Demucs (Meta), Open-Unmix

Qualité

Demucs v4 : SDR 10+ dB (qualité studio)

Classifier automatiquement les sons : genre musical, émotions dans la voix, événements sonores (alarme, verre brisé, aboiement), langues parlées, etc.

Applications

Surveillance sonore, recommandation musicale, détection d'anomalies

Modèles

AST (Audio Spectrogram Transformer), CLAP, PANNs

Supprimer le bruit de fond, l'écho, les clics, améliorer la clarté vocale. Les Transformers apprennent à distinguer signal utile et bruit, même dans des conditions extrêmes.

Cas d'usage

Visioconférences, podcasts, enregistrements anciens, téléphonie

Technologies

Krisp, Nvidia RTX Voice, Adobe Podcast Enhance

Modèles Audio Transformers populaires

Modèle de reconnaissance vocale multilingue (99 langues) avec robustesse exceptionnelle au bruit et aux accents.

ASRApprend des représentations audio par auto-supervision (self-supervised). Peut être fine-tuné sur de petits datasets.

Self-supervisedGénère de la musique haute qualité (32 kHz) à partir de descriptions textuelles. Comprend styles, instruments, ambiances.

GénérationModèle de langage audio qui génère parole et musique cohérentes à long terme (plusieurs minutes).

GénérationClone n'importe quelle voix avec 3 secondes d'audio. Synthèse vocale zéro-shot avec émotions et prosodie naturelles.

TTSAudio Spectrogram Transformer. Traite les spectrogrammes comme des images avec Vision Transformer. Excellent pour la classification.

ClassificationAvantages et limites

Contexte temporel global

L'attention capture les dépendances à longue distance (plusieurs secondes) sans problème de gradient vanishing des RNN.

Parallélisation

Contrairement aux RNN séquentiels, les Transformers traitent tous les frames en parallèle, accélérant l'entraînement.

Transfert multimodal

Facile de combiner audio et texte (Whisper), audio et vision (AudioSet), ou audio et langage (CLAP).

Qualité de génération

Les Transformers génèrent de l'audio cohérent à long terme (musique structurée, parole naturelle).

Coût computationnel

L'attention quadratique rend l'entraînement coûteux, surtout pour l'audio haute résolution (48 kHz). Whisper Large nécessite plusieurs GPU.

Latence en temps réel

Les Transformers autorégressifs (génération token par token) ont une latence élevée. Difficile pour les applications temps réel (visioconférence).

Besoin de beaucoup de données

Whisper est entraîné sur 680 000 heures d'audio. Les petits datasets donnent des résultats médiocres sans pré-entraînement.

Perte d'information temporelle fine

Le découpage en frames et la compression spectrale perdent des détails temporels fins (attaques de notes, transitoires).

Les Audio Transformers ont révolutionné le traitement du son en capturant le contexte temporel global et en permettant des tâches impossibles avec les RNN : reconnaissance vocale multilingue robuste, génération musicale cohérente, clonage de voix, et séparation de sources de qualité studio.

Des modèles comme Whisper, MusicGen, et VALL-Edémontrent que les Transformers sont universels et excellent sur n'importe quelle modalité séquentielle, pas seulement le texte.

Votre retour est précieux pour améliorer cette page. Partagez votre expérience ci-dessous.

Comment les Transformers traitent-ils l'audio ?

Comment évaluez-vous cette page ?

Pages connexes

Continuez votre apprentissage avec ces sujets liés